Искусственный интеллект Apple стал более умным, но при этом более сдержанным на WWDC 2025. Сегодня почти на каждом технологическом событии упоминается AI, и на этот раз Apple не стала исключением. В прошлом году Apple Intelligence была анонсирована, но запуск оказался не таким гладким. Многие функции либо сильно задерживались, либо вовсе отсутствовали, и вместо того, чтобы произвести фурор в мире ИИ, Apple стала объектом насмешек. Но в этом году компания выбрала иной подход. Вместо того, чтобы погружаться в ИИ с головой, Apple предложила более сдержанную презентацию — и это, похоже, было правильным решением.

Apple расширяет возможности искусственного интеллекта и добавляет поддержку восьми новых языков к концу 2025 года, включая датский, голландский, норвежский, португальский (Португалия), шведский, турецкий, китайский (традиционный) и вьетнамский.

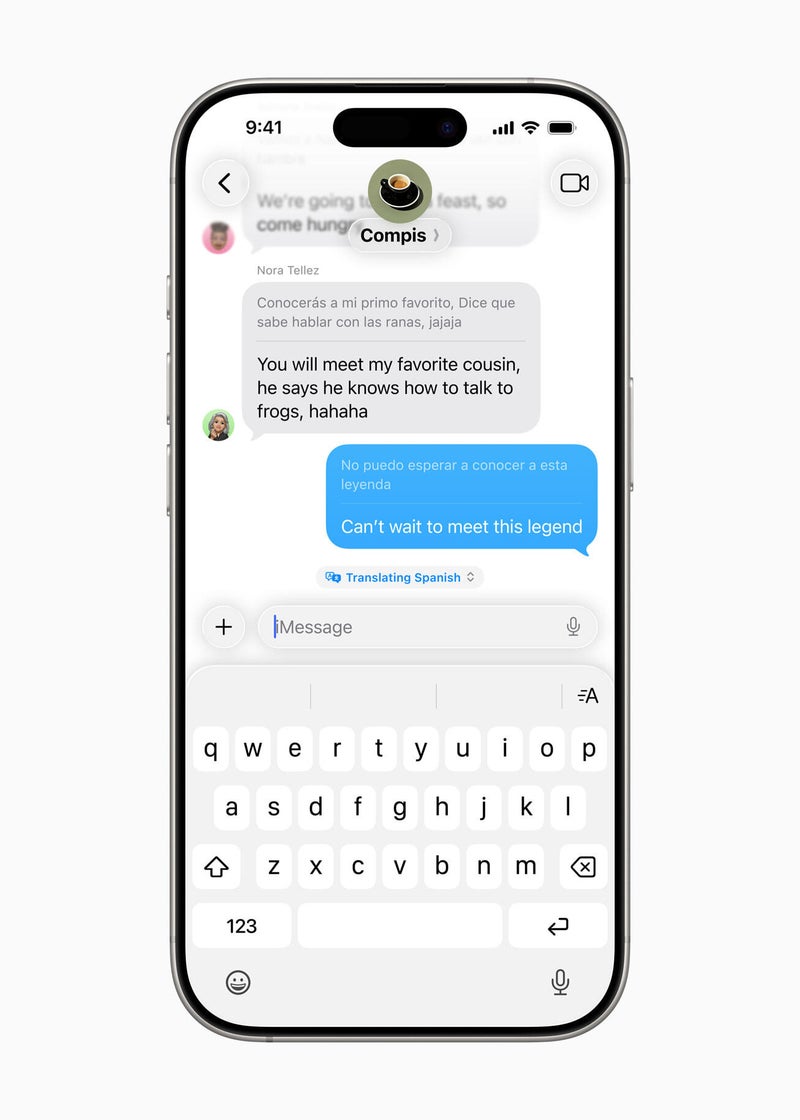

Кроме того, Apple представила новые функции с ИИ, которые улучшат пользовательский опыт на iPhone, iPad, Mac, Apple Watch и Apple Vision Pro. Одной из главных новинок стал Live Translation, который поможет преодолеть языковые барьеры при общении в сообщениях и звонках. Эта функция интегрирована в Messages, FaceTime и Phone, работает полностью на устройстве, что гарантирует конфиденциальность. Сообщения могут автоматически переводиться по мере ввода текста, а ответы мгновенно переводятся. В FaceTime будут отображаться живые субтитры с переводом на слух. В телефонных звонках — переводы в реальном времени.

Это не совсем новинка, так как Google и Samsung уже предлагают похожие функции. Например, Live Translate на Galaxy S25 и более ранних моделях.

Крейг Федериги, старший вице-президент по программному обеспечению Apple, объяснил: «В прошлом году мы начали развивать искусственный интеллект, который помогает, удобен в использовании и при этом защищает конфиденциальность пользователей. В этом году модели, которые обеспечивают работу Apple Intelligence, становятся еще более мощными, и мы интегрируем их в большее количество мест в наших операционных системах».

Помимо функций ИИ, Apple представила Genmoji и Image Playground, которые позволяют создавать персонализированные эмодзи, настраивать выражения лиц и прически, а также генерировать изображения в новых художественных стилях, таких как масляная живопись или векторная графика — все это с помощью ChatGPT. И не переживайте, все данные остаются конфиденциальными, и ничего не передается без вашего разрешения.

Если эмодзи — не ваше, Apple расширила возможности визуального интеллекта. Теперь вы можете взаимодействовать с экраном, искать и выполнять действия по тому, что видите, прямо в приложениях. Например, если вы заметили понравившийся стул, можно выделить его и найти в интернете похожие товары. Визуальный интеллект также может распознавать события и предлагать добавить их в календарь, извлекая такие данные, как дата, время и место прямо из того, что вы видите.

Apple также расширила возможности ИИ для Apple Watch. Новая функция Workout Buddy использует данные о тренировках, чтобы предоставлять персонализированные советы в реальном времени, основываясь на вашем пульсе, темпе, расстоянии и других показателях. Она будет предоставлять мотивационные комментарии через динамический голос, созданный на основе тренеров Fitness+. Workout Buddy работает только на Apple Watch, в паре с Bluetooth-гарнитурой и требует рядом находящийся iPhone с поддержкой Apple Intelligence. Функция будет поддерживать популярные виды тренировок, такие как бег, ходьба, велосипед, HIIT и силовые тренировки.

Кроме этих главных новинок, Apple Intelligence теперь может извлекать данные о доставке из ваших писем и показывать сводку, а также предлагать голосования в групповых чатах, когда, по мнению системы, они могут быть полезны. Также есть мелкие улучшения в приложениях: напоминания теперь автоматически категоризируют важные действия из писем, сайтов и заметок, а Apple Wallet подытоживает информацию о доставке по письмам от продавцов.

Тем, кто ждал более персонализированную Siri, придется подождать еще немного. Apple ясно дала понять, что новые функции появятся в этом году, но они не будут доступны в первых бета-версиях iOS 26, iPadOS 26 и macOS 26. Ожидается, что Siri будет лучше понимать контекст, будет более осведомлена о событиях на экране и предоставит больше настроек для индивидуальных приложений.

6 комментариев

Genmoji? Что это вообще такое, лол. Я лучше буду использовать обычные эмодзи

Хочу, чтобы Siri была умнее, но, наверное, придется подождать еще немного 🤷♂️

Apple Watch продолжает улучшаться с каждым обновлением! Но сколько будет работать с этими новыми функциями?

Лол, Apple все еще пытается догнать Google и Samsung 😂

Визуальный интеллект крутой, но звучит немного как фишка для маркетинга. Это реально помогает?

Жду, когда функция перевода будет поддерживать все языки, а не только самые популярные 🤔